Milin

Results

2

comments of

Milin

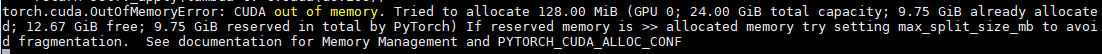

我也遇到类似问题了,chatglm-6b一直起不来,24G显存才用不到10G,就报OOM了。环境变量配置了:PYTORCH_CUDA_ALLOC_CONF="max_split_size_mb:24" 也不顶用。。。 - OS: Debian11(WSL2) - Python: 3.10.10 - Transformers: 4.27.1 - PyTorch: - CUDA Support: True