YanChuan

YanChuan

按照官方教程配置好环境后,报如下错: Now, onnx2paddle support convert onnx model opset_verison [9],opset_verison of your onnx model is 12, automatically treated as op_set: 9. Total nodes: 248 Nodes converting ... Converting node 327 ......

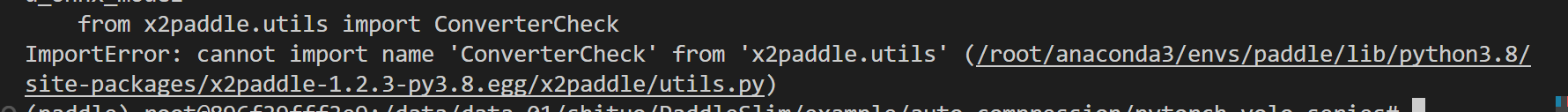

按照官方配置好环境后,运行报错:  按照https://github.com/PaddlePaddle/X2Paddle/issues/494 的方法 更新x2paddle后,又报下面的错:  PaddlePaddle = 2.3.2 x2paddle 是develop分支代码git后安装 更新onnx 版本和 x2paddle后又报这个错  目前没有找到解决方法。 麻烦看一下 谢谢 wechat : ST_YangMu

直接跑源码的qlora.py,报错  给model.child = LoraLinear(100, 200, 10)改为model.child = LoraLinear(100, 200, 10,10,2)后,又报错

### Prerequisite - [X] I have searched [the existing and past issues](https://github.com/open-mmlab/mmyolo/issues) but cannot get the expected help. - [X] I have read the [FAQ documentation](https://mmyolo.readthedocs.io/en/latest/faq.html) but cannot get the...

能麻烦说一下eval具体该怎么做吗,非常感谢

训练指标问题

你好,我用facev2代码和yolov5s的6.1版本训练widerface,30个epoch,怎么还没有v5s的指标高呢。是有训练方法吗?预训练权重使用的是yolov5s.pt。 (上图是yolofacev2,下图是yolov5s)

loss.py 213行报错 f self.u > 0: obji = self.BCEobj(pi[..., 4], tobj, auto_iou)