JAVA

JAVA

这里写的没有问题,但是Resnet34写的不是正常的代码,正常代码层数为3.4.6.3层结构,作者这里写成了4.5.7.4层结构, for i in rang(1,block_num) 应该是block_num-1才对,因为之前layers.append了一次。

用的是Resnet34,跑了80个周期,准确度稳定在96.2%附近; val_accuracy: 96.200000 epoch 82 19it [00:09, 2.14it/s]Test Loss: 0.142546 39it [00:18, 2.14it/s]Test Loss: 0.146829 59it [00:27, 2.15it/s]Test Loss: 0.146377 79it [00:37, 2.15it/s]Test Loss: 0.148034 99it [00:46, 2.15it/s]Test Loss: 0.144496...

代码写的太不走心了,太多的bug,估计都没有调试,瞎写的

这是唯一一个tensorflow写的看不懂的代码,

请问你测试中国人脸的时候,精度也是有0.9以上么,

> > > > trainable置为True就不是测试了,而且batchNorm层的参数也会更新,你转成pb文件后能检测到物体就奇怪了。 > > > > > > > > > 如果我把trainable设置为False,则evaluate的结果什么都预测不到,0%MAP。如果把trainable设置为True,MAP能到90%多。是我没有训练好是吗? > > > > > > 描述问题的时候能不能说说什么数据集呢,还有怎么训练的呢?我觉得是你没训练好吧,因为batchNorm是解决过拟合而生,从你描述的问题来看应该是过拟合了。 > > 已经解决了,谢谢,貌似是因为欠拟合。我把训练次数弄上去问题就解决了 确实是欠拟合造成的; 以raccoon数据为例,200张图,训练180张,测试20张, 训练20+30个周期,loss下降到0.4,单张图可以测试出结果,但是mAP=0,把trainable=True,mAP=97%,但是看detection结果确实是不好; 训练100+200个周期,loss下降到0.10,把trainable=False,可以测试出mAP=100%;看detection结果确实是好。测试训练图像180张,mAP=100%。

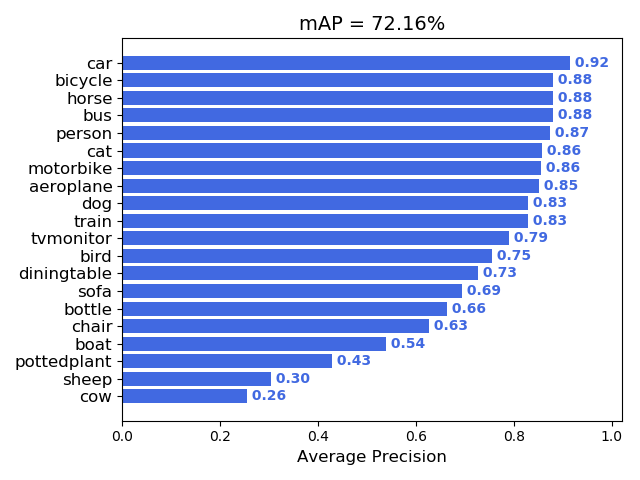

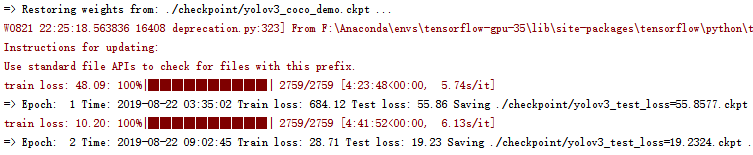

> > 训练了30个epoch,mAP能达到0.72 > >  > >  > 我的一个enpoch四个多小时正常吗 应该不正常,我一个epoch大概15分钟不到,GTX2080TI

> ......我怎么就50轮才六十多。。。。。。 yolov3_test_loss=9.7718.ckpt-50 mAP=0.70 请问知道什么原因么,训练50周期也才70

> 试了一些参数,mAP达到0.88 >  能告知调了那些参数么,跪求

train: epoch 499 : 16/ 20: loss: 92.8000 train: epoch 499 : 17/ 20: loss: 107.7473 train: epoch 499 : 18/ 20: loss: 99.2222 train: epoch 499 : 19/ 20:...