chunjun

chunjun copied to clipboard

chunjun copied to clipboard

A data integration framework

以下是报错日志: 2022-06-10 03:58:03.562 [main] INFO org.apache.flink.configuration.GlobalConfiguration - Loading configuration property: jobmanager.rpc.address, localhost 2022-06-10 03:58:03.566 [main] INFO org.apache.flink.configuration.GlobalConfiguration - Loading configuration property: jobmanager.rpc.port, 6123 2022-06-10 03:58:03.566 [main] INFO org.apache.flink.configuration.GlobalConfiguration - Loading...

场景是这样的: 需要将业务数据从mogodb同步到Elasticsearch中,mogodb中会不断地有数据新增,并且mogodb会存在更新旧数据的场景,更新的方式是将mogodb中旧数据删除,插入新数据的方式完成更新 所有有两个问题想请教一下 1,同步任务执行完成后,任务是否就结束不在同步了?还是说同步任务会处在等待状态,当mogodb有新的数据产生时,会将新数据继续同步过去? 2,因为使用mogodb更新数据的方式是通过删除旧数据插入新数据的方式来更新数据,那么数据同步到es的时候,也需要通过相同的方式来完成数据的更新,不知道是否支持这样的操作呢? 期待回复,感谢

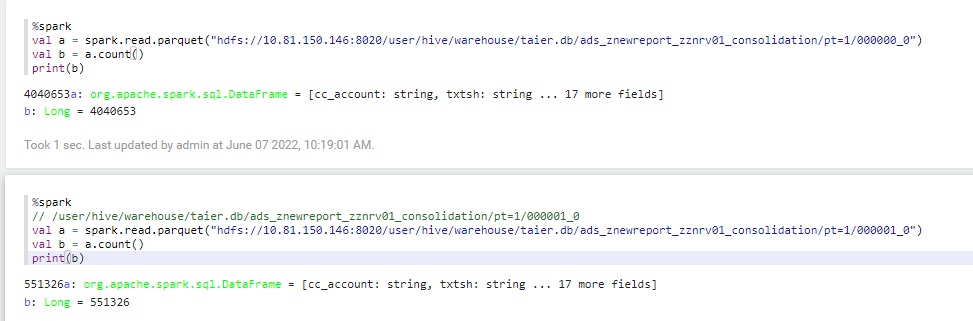

读取不到hive数据 配置如下(配置为太阿生成) [h2star.json.txt](https://github.com/DTStack/chunjun/files/8850513/h2star.json.txt) [err.log](https://github.com/DTStack/chunjun/files/8850482/err.log) 使用spark可以读取  另外window本地测试有个小bug BaseHdfsInputFormat 136行 文件分隔符为\ 导致后边报错数组越界

refactor chunjun-web : https://dtstack.github.io/chunjun-web/

为刚接触chunjun或需要快速使用的同学提供一个docker的镜像。 镜像名: ``` dtopensource/chunjun-master ``` 提供了以下可选项: 1. 直接启动,默认使用chunjun-examples/json/stream/stream.json这个任务,standalone模式 ``` docker run -p 8081:8081 dtopensource/chunjun-master ``` 2. 指定文件 /Users/kunni/IdeaProjects/chunjun/chunjun-examples/json/stream/stream.json是在你机器上的文件,docker内挂载的目录必须是/opt/flink/job 任务类型根据文件名自动推断:例如stream.json是sync任务,stream.sql是sql任务 ``` docker run -p 8081:8081 -v /Users/kunni/IdeaProjects/chunjun/chunjun-examples/json/stream/stream.json:/opt/flink/job/stream.json dtopensource/chunjun-master ``` 3. 指定模式...

当使用binlog方式同步数据时,数据库变更记录类型“rowKind”如何作为普通字段提取出来? 下面是我通过json配置文件方式的例子: { "job" : { "content" : [ { "reader" : { "parameter" : { "username" : "root", "password" : "123456", "cat" : "insert,delete,update", "jdbcUrl" : "jdbc:mysql://localhost:3306/test_cdc?useSSL=false", "host" :...

when I insert a large batch data to clickhouse , this error will appear. ``` DB::Exception: Timeout exceeded: elapsed 5.001140127 seconds, maximum: 5: ```

提个想法:是否可以在chunjun项目里增加个flinkx-udfs or chunjun-udfs(udafs/udtfs 名称待定)模块。 加这个模块的的作用主要有两点: 1、解决flink 1.12 缺少新版本的一些内置函数,因为永远也跟不上flink 社区版本的节奏。 2、收集汇总常用的udfs ,就算flink 社区开发再快,也有一些没有特性函数,比如nginx ip 查询ip库解析。 3、比如现在版本缺少json内置函数,首先我还要另开项目去开发,开发完还要想办法集成到chunjun里进行测试。 4、待补充,其它优势就不一一列举了 各位看看这个想法如何?欢迎补充