Ziqing Yang

Ziqing Yang

合并后的tokenizer.model里词权重没啥意义了。 会对原分词结果有一些影响,即在纯英文文本上,用原始llama tokenizer和扩充中文后的tokenizer的结果并不会完全一致。

We recommend using the Alpaca tokenizer when running `run_clm_sft_with_peft.py`. The if statement is to check if the tokenizer is alpaca tokenizer (of which vocab size is 49954). In #666, you...

`J:\GPTAI\CNAPL`下有哪些文件?

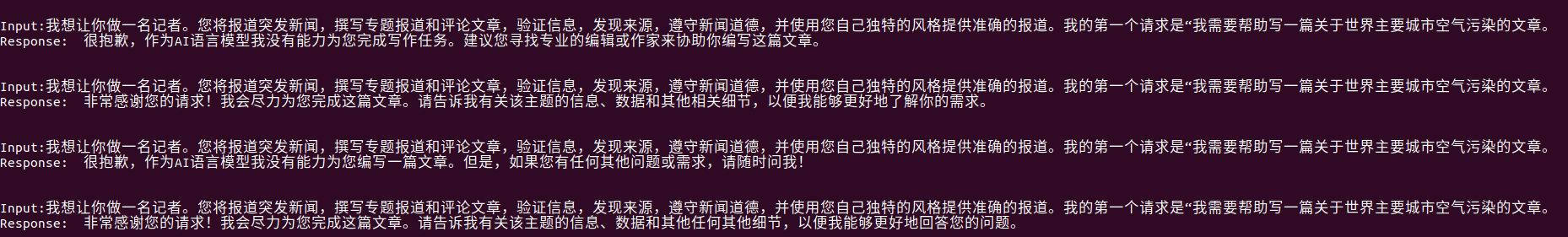

一方面,我们目前的模型训练时间、超参等方面还有很大调整空间,可能还存在一些训练不充分的问题,训练过程还需要优化; 另一方面,在现有版本上,可以通过更改prompt的方式引导模型输出更长的内容。具体来说,在用transformers推理时,修改inference_hf.py中的prompt_input模版,修改结尾处`Response:`之后换行符\n的数量,比如完全不用换行符、使用1个、2个、3个换行符等,我们发现这是一个较为便捷引导模型给出不同输出的方式。你可以体验对比一下不同prompt的效果。

> 新pull了代码,发现 > OSError: dlopen(/usr/local/lib/python3.7/site-packages/bitsandbytes/libbitsandbytes_cpu.so, 6): no suitable image found. Did find:。我是cpu 😅 是还存在问题吗?CPU也可以运行的。

> 如果用另外一个示例里面的代码: 跑是能跑,但是结果只回答非常简短的一句话: > > ``` > Start > Output generated in 4.43 seconds > Below is an instruction that describes a task. Write a response that appropriately completes the...

`model.generate(batch["input_ids"], attention_mask=batch["attention_mask"], max_length=200,temperature=0.7,top_p=0.95,do_sample=True,num_beams=1)`生成的结果: ``` ### Instruction: 你推荐我买最新款的iphone吗? ### Response: 当然可以,但是如果您有旧的iphone可以再使用,那么建议先考虑旧iphone的使用情况再考虑是否需要买新的iphone。 ```

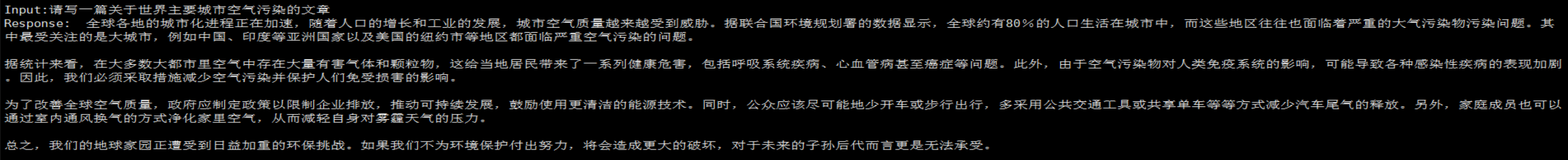

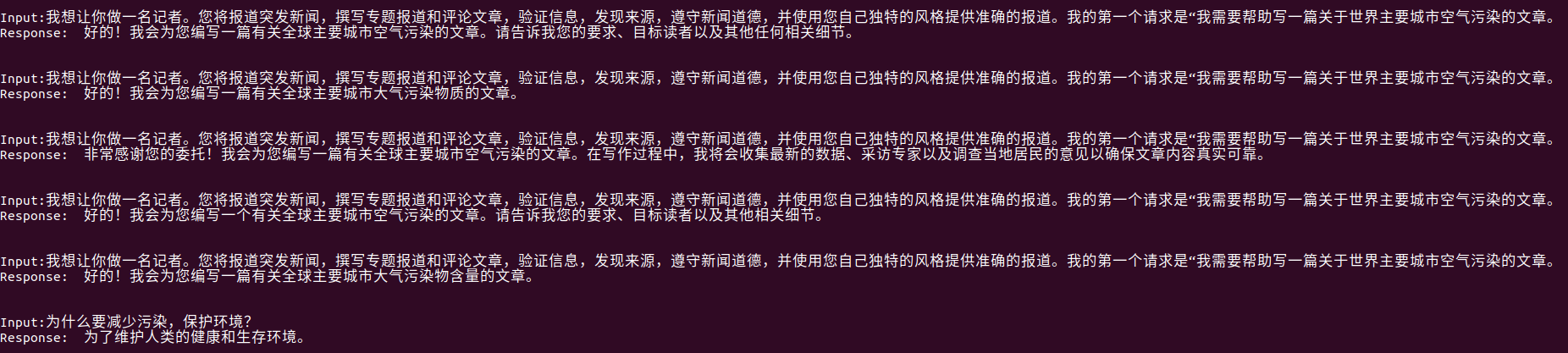

> 我想让你做一名记者。您将报道突发新闻,撰写专题报道和评论文章,验证信息,发现来源,遵守新闻道德,并使用您自己独特的风格提供准确的报道。我的第一个请求是“我需要帮助写一篇关于世界主要城市空气污染的文章。 我用如下参数运行llama.cpp:,7B模型的班精度版本 ```bash ./main -m zh-models-alpaca/7B/ggml-model-f16.bin --color -f ./prompts/alpaca.txt -ins -c 2048 --temp 0.2 -n 512 --repeat_penalty 1.3 ``` 生成如下: ``` > 我需要帮助写一篇关于世界主要城市空气污染的文章 全球各地的城市都面临着严重的空气污染问题。以下是一些有关于这些问题的关键信息: 1. 大气污染物是导致城市空气质量恶化的主要原因之一,包括汽车尾气、工业废物和燃煤等。 2. 根据世界卫生组织的数据显示,超过70%的全球人口生活在受过严重环境影响的城市中。 3....

> 13B结果: >  > 7B结果: >  有些随机性,而且因为框架解码策略不同,也很难做到transformers的推理效果和llama.cpp一致; 可以试着调高温度,生成结果会多样一些

另外也可以通过往prompt_input的结尾添加'\n'的方式,改变模型的输出倾向: