Inference with FasterTransformer

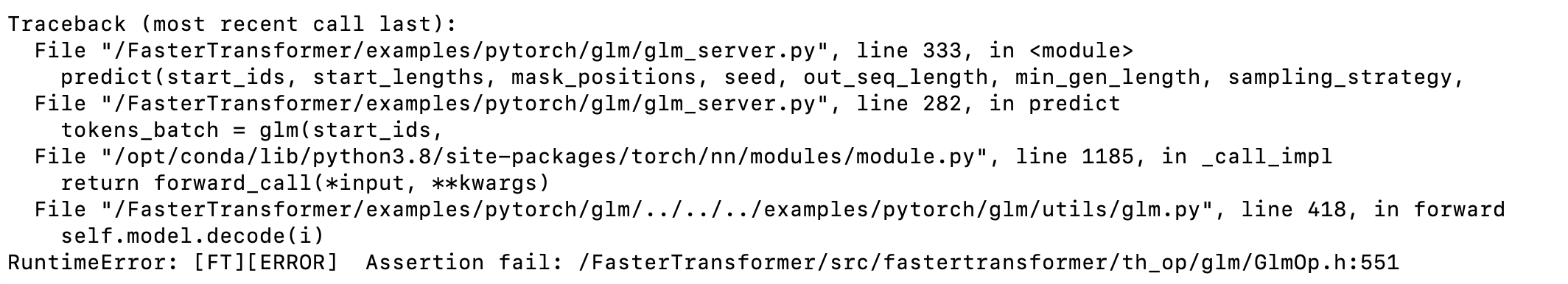

使用docker构建GLM-130B的API,server正常启动了,但是在使用glm_server_test.py测试时报错。

使用docker构建GLM-130B的API,server正常启动了,但是在使用glm_server_test.py测试时报错。

请问解决了么?

大佬问个问题能不能加个微信

大佬我报了 glm_server.py: error: unrecognized arguments: checkpoint path> 这个错

docker run -it --rm --gpus all --shm-size=10g -p 8500:8500

-v /data/LLMs/glm-130b-sat/49300:/checkpoints:ro

-e MPSIZE=8 -e DATA_TYPE=int8

ftglm:latest

我路径写的有问题吗?

我也遇到了这个错误请问解决了嘛

大佬我报了 glm_server.py: error: unrecognized arguments: checkpoint path> 这个错 docker run -it --rm --gpus all --shm-size=10g -p 8500:8500 -v /data/LLMs/glm-130b-sat/49300:/checkpoints:ro -e MPSIZE=8 -e DATA_TYPE=int8 ftglm:latest 我路径写的有问题吗?

https://github.com/THUDM/FasterTransformer/blob/dd801cd23886b11912dc64bfc9fc4b709b3988e4/examples/pytorch/glm/glm_server.sh#L27 把这一行注释掉或者改为/checkpoints