MOSS

MOSS copied to clipboard

MOSS copied to clipboard

An open-source tool-augmented conversational language model from Fudan University

目前只用了量化版的脚本进行推理,但是不清楚怎么去设置联网 & 插件开关,直接用现有没经过量化的会报错, .index.json没找到

如题,希望大佬能解答,目前是3090和3080上一句hello回答1m30s左右

使用pip 安装 autotune-0.0.3 后仍存在这个问题

整体文件上也查看了,确实是没有xxx.index.json文件。 https://huggingface.co/fnlp/moss-moon-003-sft-int8/tree/main 标准的未量化的。https://huggingface.co/fnlp/moss-moon-003-sft/tree/main内包含有index.json文件。

在安装triton时老是提示下面两个错误: ERROR: Could not find a version that satisfies the requirement triton (from versions: none) ERROR: No matching distribution found for triton 查了下,网上回答是triton包不支持windows...这个能不能注释一下...或者有没有哪位大神有编译好的whl包?目前只找到适用于python3.10的,这里又要求python3.8

有什么方法可以在Tesla P40上跑起来的方案吗?

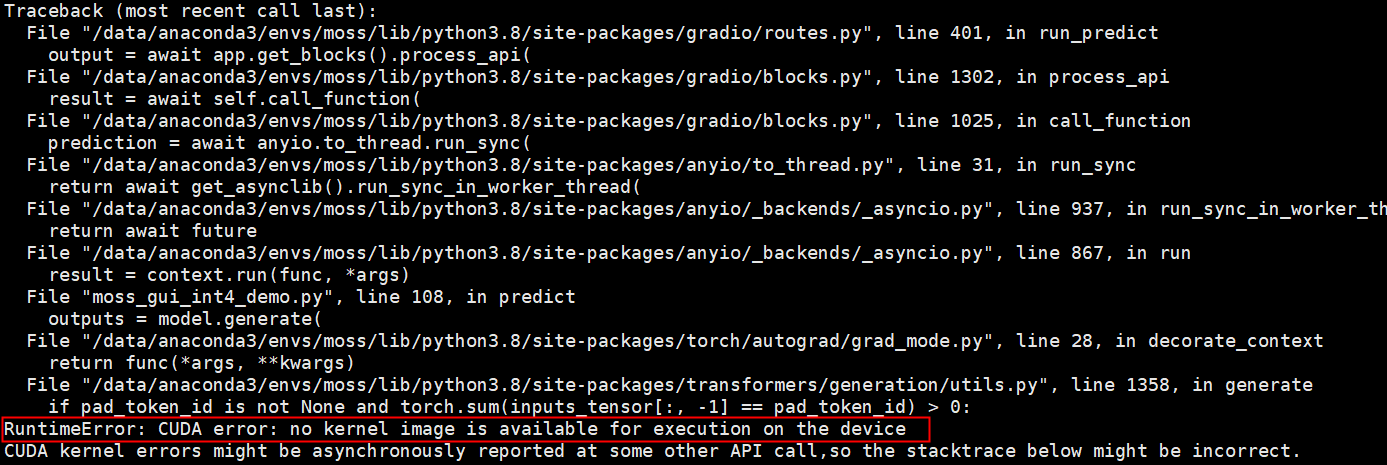

3090显卡,CUDA11.1版本,单卡运行INT4推理报错  是CUDA版本的问题吗?MOSS最低CUDA版本是哪个?

File "c:\users)AdministratorlDesktop)MoSS)mosscli-demo.py", line 73, in main inputs.input_ids.cuda(),

请问如何申请API,有何要求和流程

如何修改人设?

如题,好奇