codis

codis copied to clipboard

codis copied to clipboard

Proxy based Redis cluster solution supporting pipeline and scaling dynamically

想要修改默认的1024 个slots 目前是修改pkg/models/slots.go 文件下const MaxSlotNum 之后重新编译 发现dashboard页面基本没变,offline 的地方有点变化 实际set key 的时候 还是会出现ERR handle request, slot is not ready, may be offline,感觉算法还是1024 取余没有变啊 请问其他还有哪里需要做修改吗?

etcd is broken here, use codis from pika https://github.com/OpenAtomFoundation/pika

Hello, thank you for your app. Is there a way to make Codis work with DragonflyDB (https://github.com/dragonflydb/dragonfly)? I catch an error: ERR unknown command SLOTSINFO

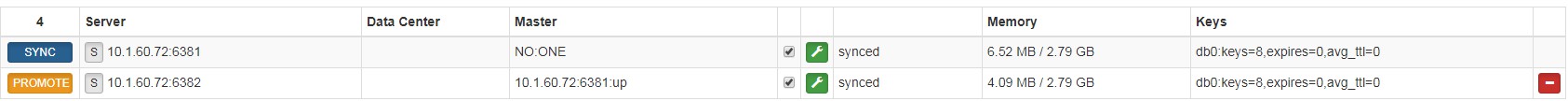

在使用codis-ha时出现如下问题,不知是否正常。 **场景如下**: 启用codis-ha后,当一个组内的master节点down掉后,codis-ha会选举group内的一个slave节点作为master节点。**但随即会剔除group内除新提升为master的节点以外,其他所有节点都会被强制剔除且服务器上确认codis-server进程退出。** 当手动启动被剔除的节点后,再次添加到该group依然无法添加(添加后会被自动剔除且进程自动退出)。 **此外,想要了解一些问题**: 1. 想要了解codis-ha的实现机制,是基于redis-sentinel实现的吗? 2. codis-ha在使用时,需要另外以sentinel的模式运行redis吗? 3. codis-ha的主从切换是怎样的? 4. 后续的数据同步的流程(当原master重启上线再加入到group中时)是怎样的呢? **望解答,谢谢。** ---- #### 相关信息如下 **group组实例**  6181为master,6282为slave。 **Codis-server日志信息** 6381 > 8541:signal-handler (1521448920) Received SIGTERM scheduling shutdown... 8541:M...

codis3.2.2的zookeeper被别人意外删除了,无法恢复的情况下,dashboard也运行不起来,proxy和server都在正常运行的情况下,怎么补救恢复slots分组同步到新的zookeeper上面?还有救?

背景:使用redis-migrate-tool向codis+pika的架构同步数据,同步模式为全量+增量,源端为redis cluster 4.0,目标端为coids-proxy地址,目前可以正常同步,但是到增量阶段大概8小时左右,就会出现session close的错误,导致同步进程Crash,redis-migrate-tool日志没有任何报错,在codis proxy日志只可以看到: ``` 2023/05/25 15:51:16 session.go:83: [INFO] session [0xc012833600] create: {"ops":0,"create":1685001076,"remote":"192.168.3.26:39470"} 2023/05/25 22:53:10 session.go:90: [INFO] session [0xc012833600] closed: {"ops":136162772,"create":1685001076,"lastop":1685026390,"remote":"192.168.3.26:39470"}, error: EOF ``` codis配置文件为: ``` "config": { "proto_type":...

愿意帮助维护 https://github.com/cloudxaas/codis 吗? We can make it from 1024 to 16384 and 65535 settings

proxy 处理请求的过程中经常需要分配 `proxy.Request` 和 `redis.Resp` 两种对象。这个 PR 通过 `sync.Pool` 进行了复用,应当可以降低GC压力。 `proxy.Request` and `redis.Resp` is allocated most often in request processing. This PR try to reuse these objects using `sync.Pool` which...

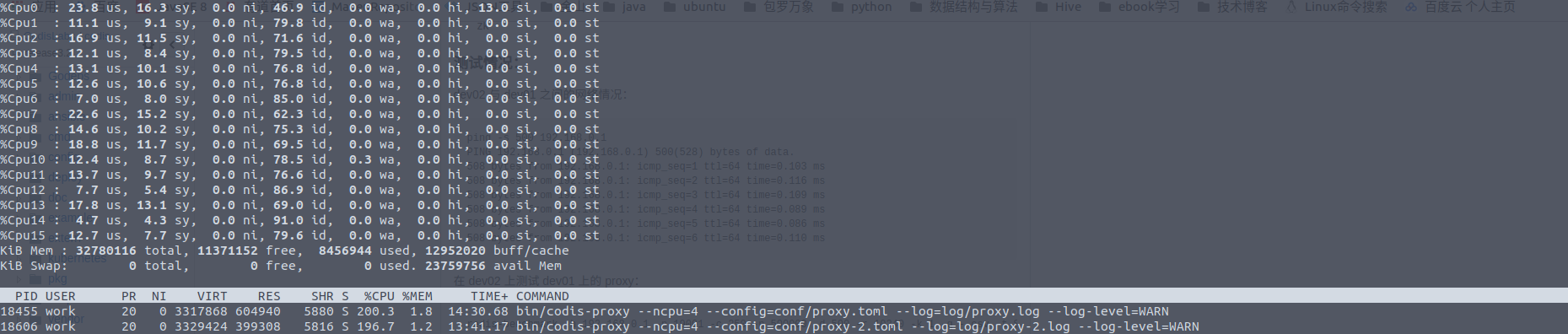

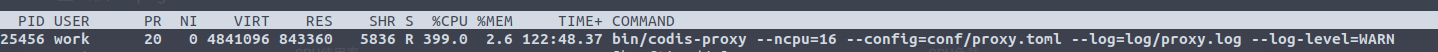

proxy启动命令:nohup bin/codis-proxy --ncpu=16 --config=conf/proxy.toml --log=log/proxy.log --log-level=WARN & 1、发现proxy最多占用4个核,其他的核都空闲。 2、单机启动两个proxy进程 nohup bin/codis-proxy --ncpu=4--config=conf/proxy.toml --log=log/proxy.log --log-level=WARN & nohup bin/codis-proxy --ncpu=4--config=conf/proxy-2.toml --log=log/proxy-2.log --log-level=WARN & 每个proxy最多占用2核,一共也是4核。 这是什么问题啊?