如何训练可以得到77maP

想问一下如何训练可以得到您给出的在voc上77mAP的权重?可以问一下训练策略吗?我在你的代码中注释了对预训练文件的引入,直接使用原始ResNet网络进行train.py文件中100epoch的训练,得到的训练效果很差?想问怎样可以训练出和您相同的voc的结果呢?

pretrain=True可以用主干的预训练权重吧

同问,请问你解决了嘛?

想问一下如何训练可以得到您给出的在voc上77mAP的权重?可以问一下训练策略吗?我在你的代码中注释了对预训练文件的引入,直接使用原始ResNet网络进行train.py文件中100epoch的训练,得到的训练效果很差?想问怎样可以训练出和您相同的voc的结果呢?

同问,请问你解决了嘛?

想问一下如何训练可以得到您给出的在voc上77mAP的权重?可以问一下训练策略吗?我在你的代码中注释了对预训练文件的引入,直接使用原始ResNet网络进行train.py文件中100epoch的训练,得到的训练效果很差?想问怎样可以训练出和您相同的voc的结果呢?

为啥会忽略我中间的回答呢…

呃,主要是我试了你用pretrain=True也是这样30%的map

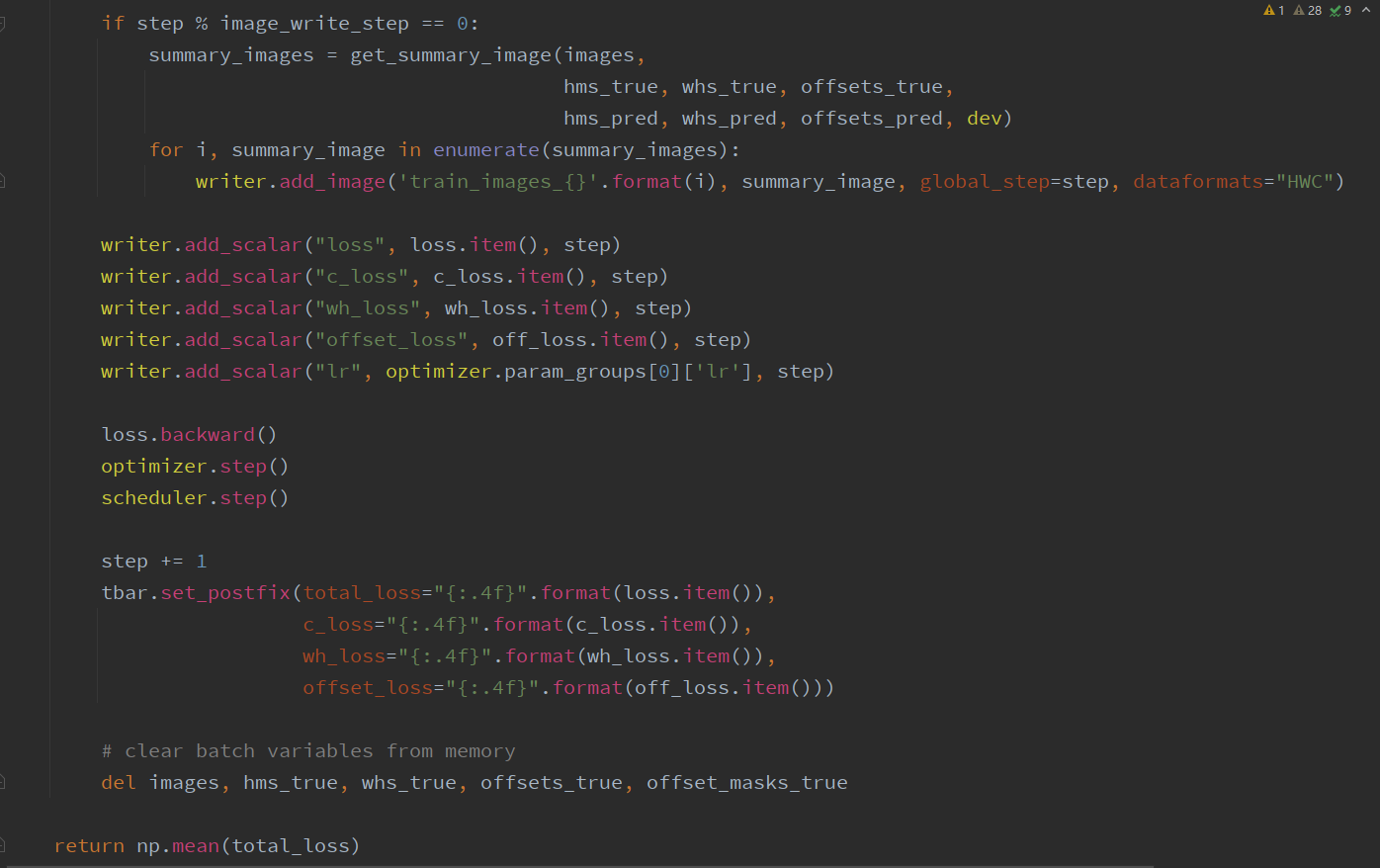

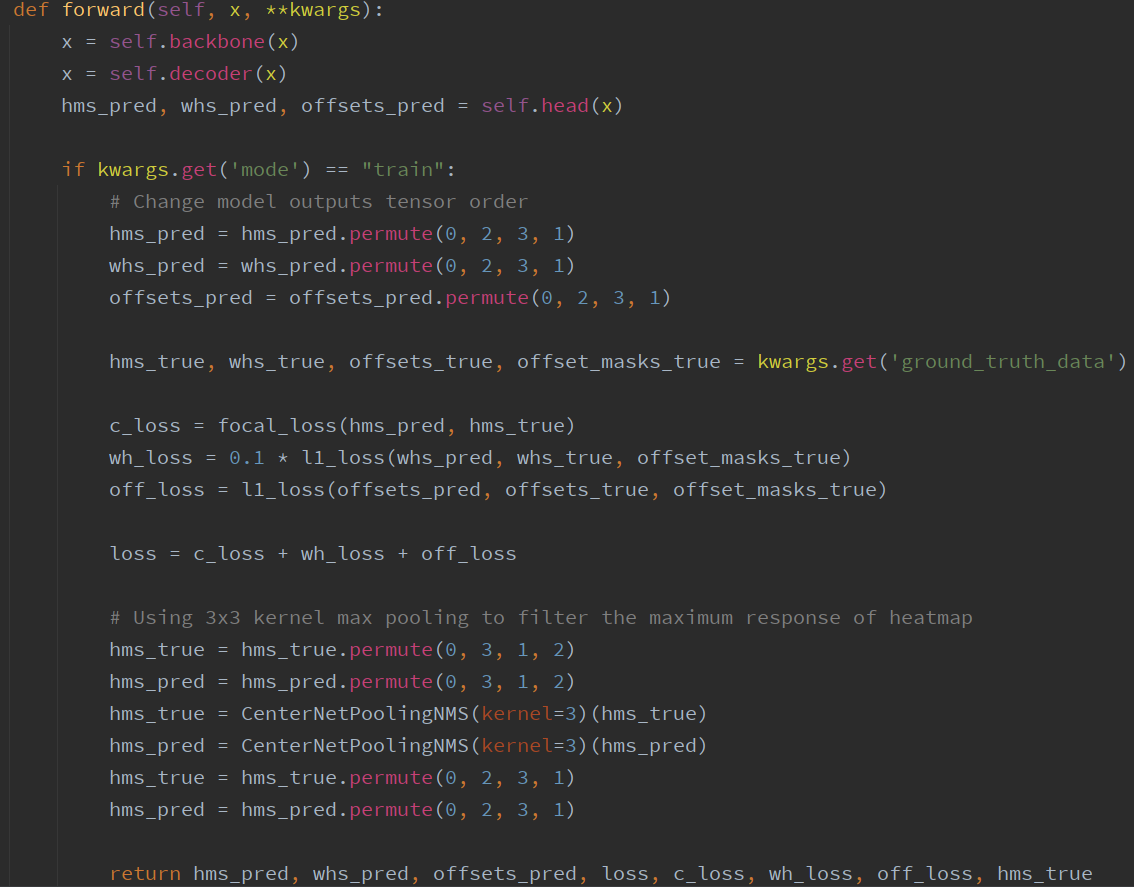

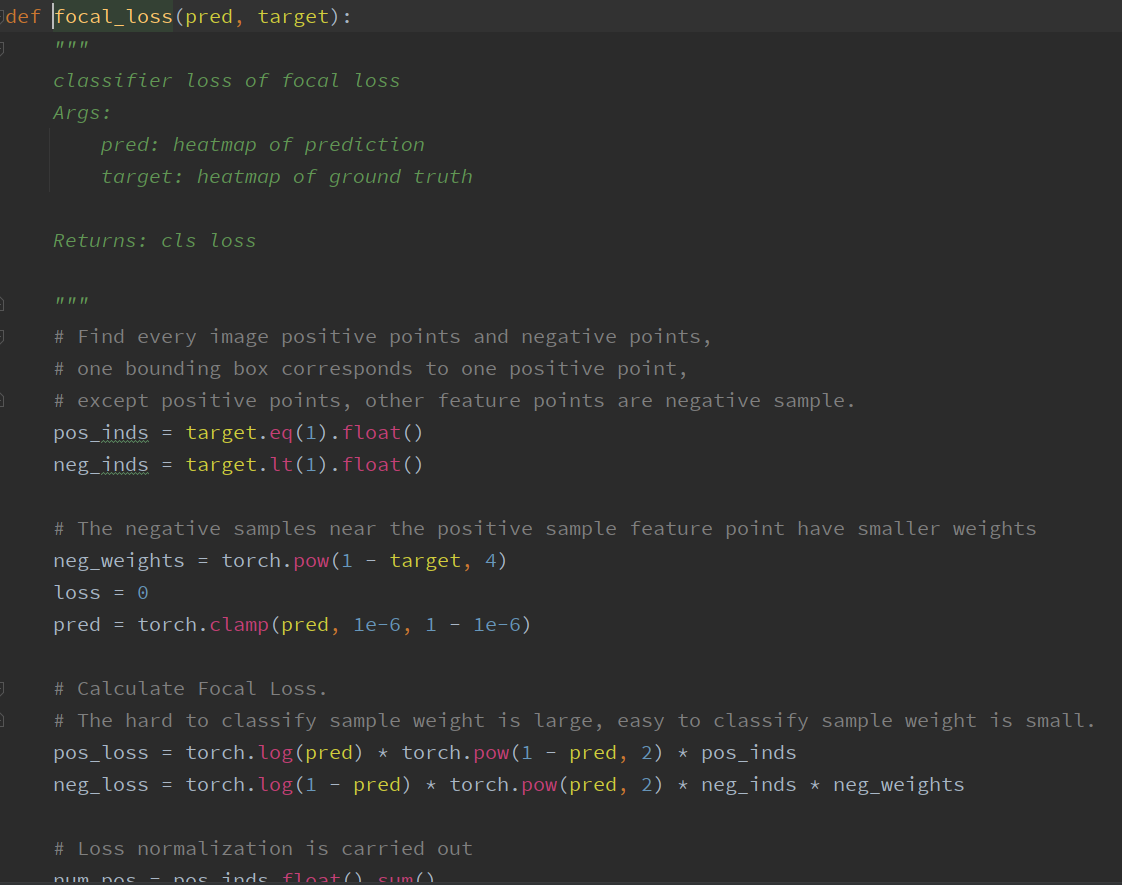

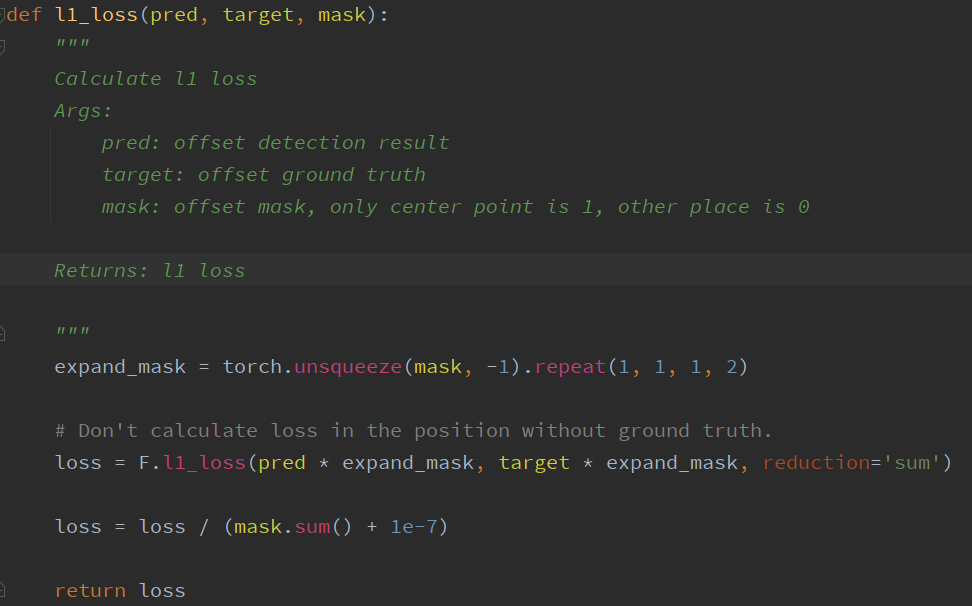

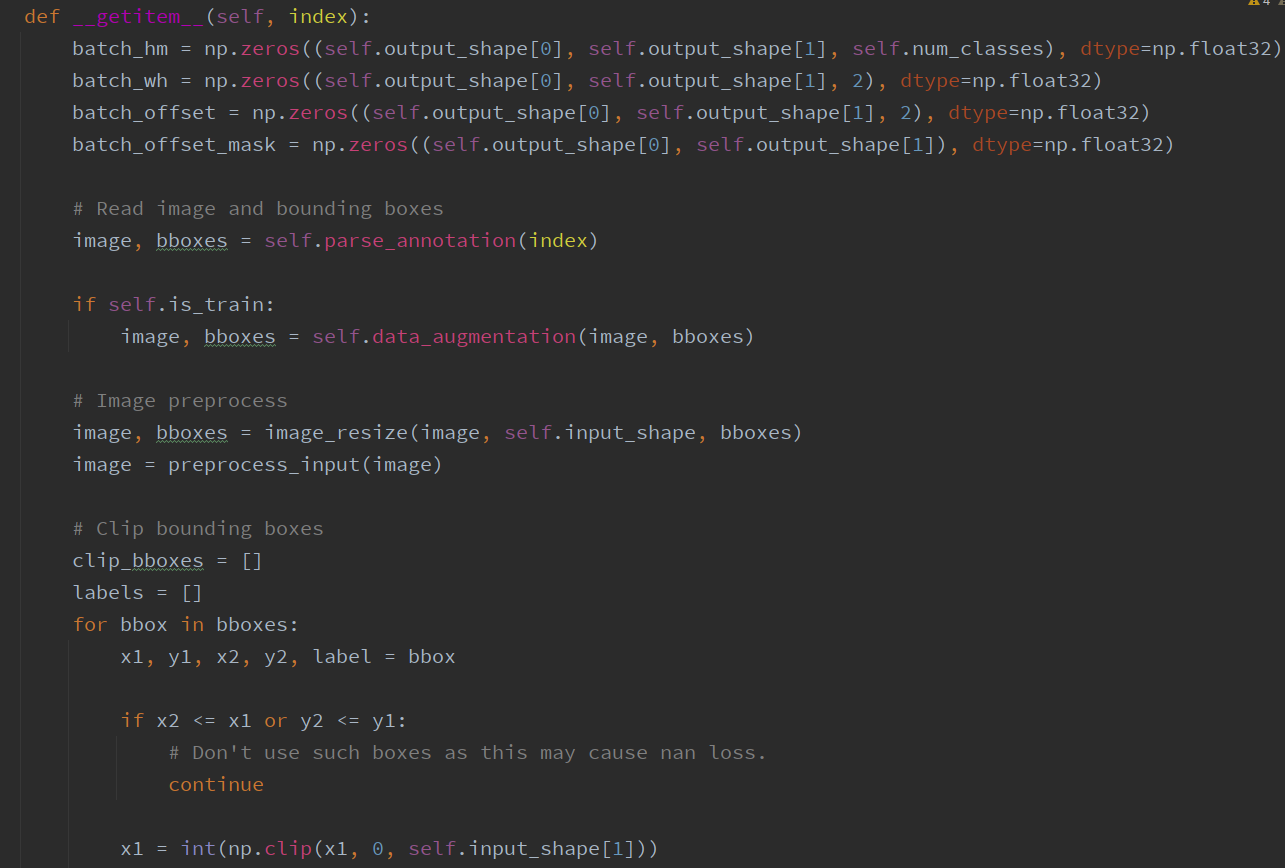

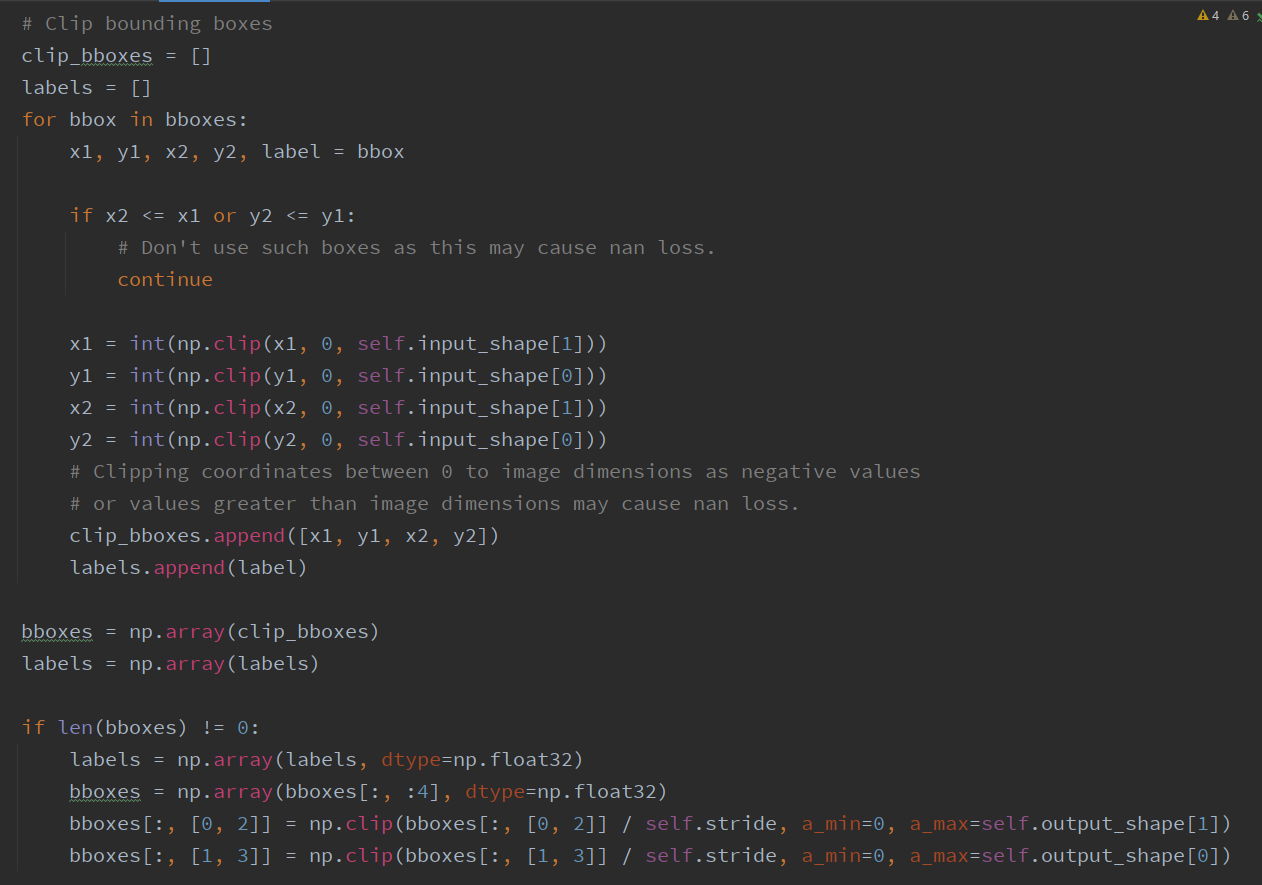

截图,训练策略也截图,loss也截图

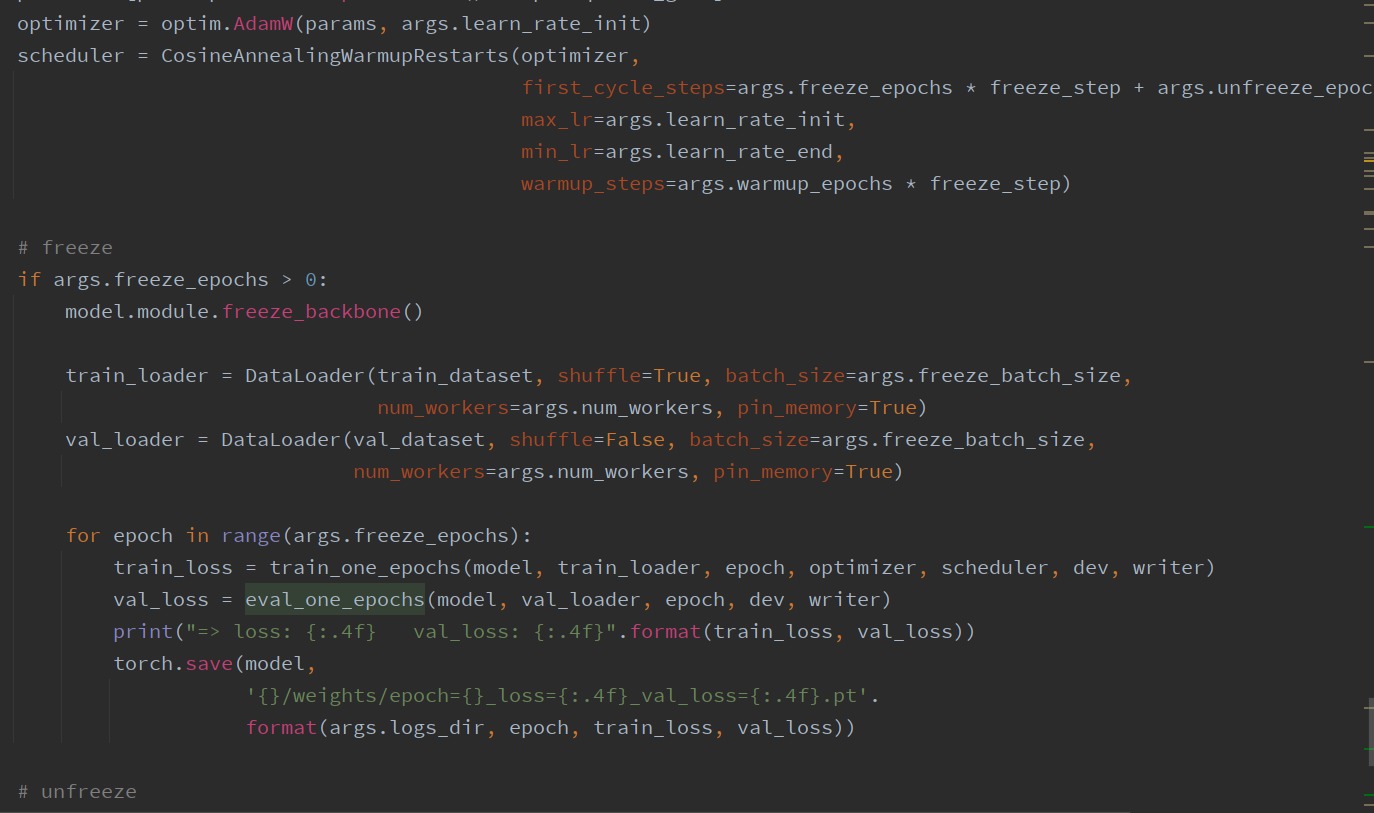

Train

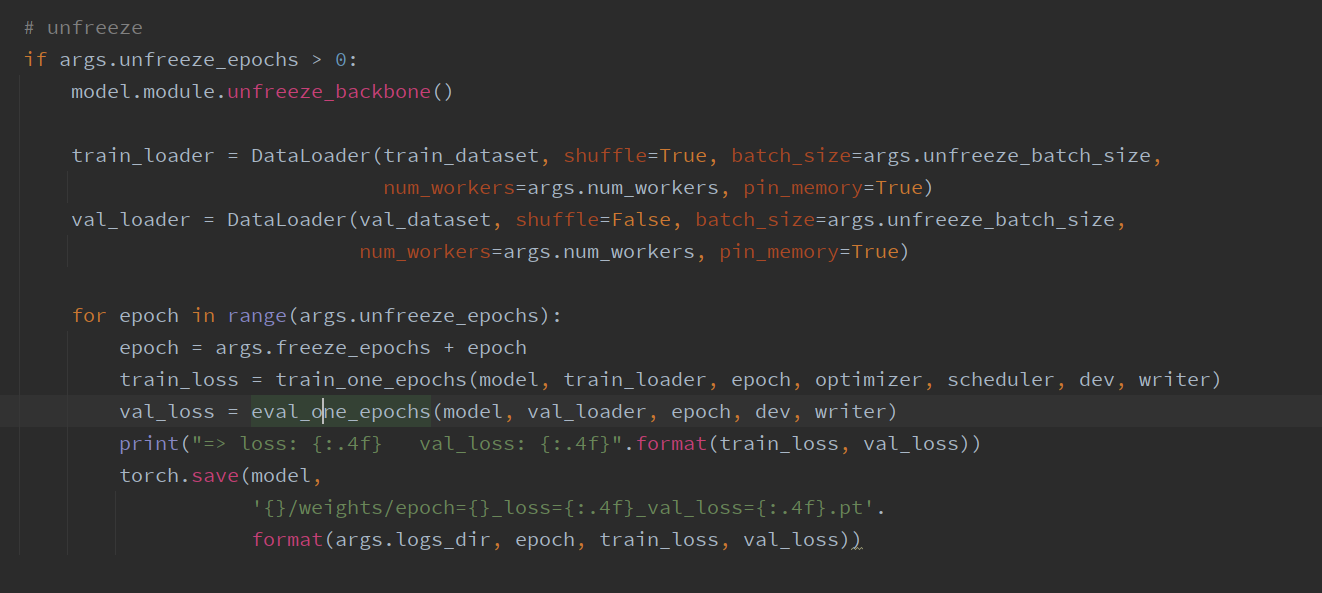

Train one epochs

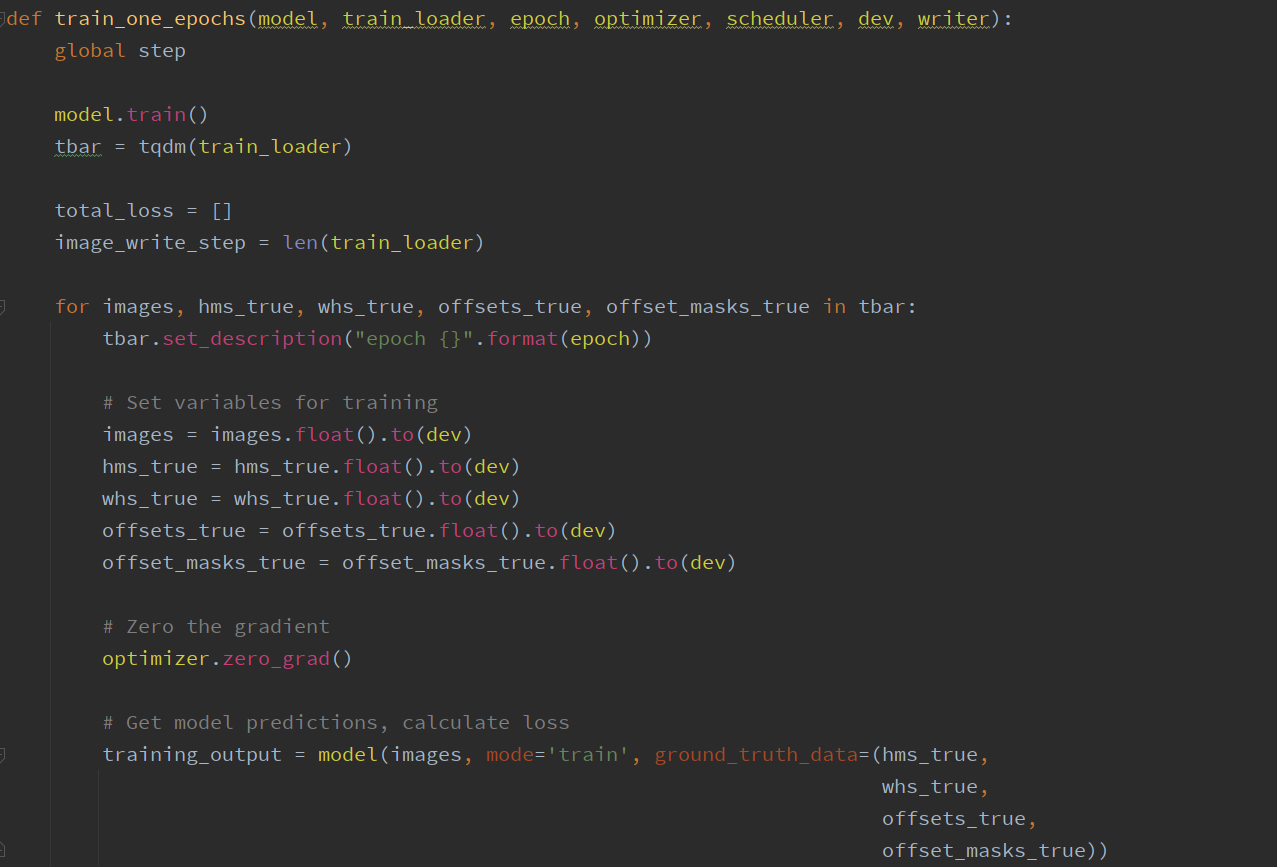

Loss

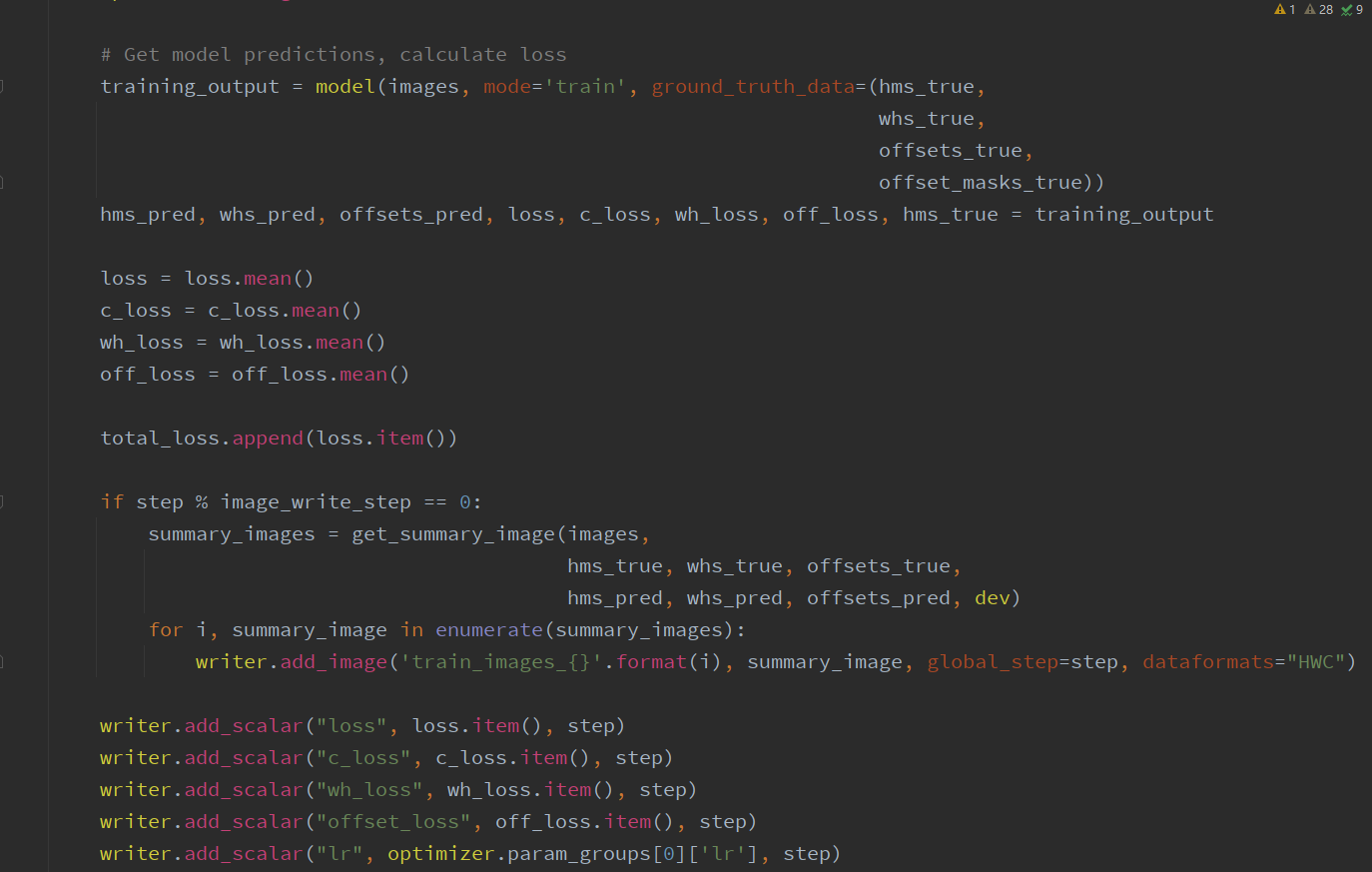

Dataloader

DataLoader 和 Loss基本按照你的方式写的。训练策略稍有改动,但我感觉Loss和data都一样的情况,应该没啥问题。

你咋改了这么多…

是呀,跟着你的讲解自己又重新加了一点。

你这个改的有点多啊……我看l1_loss里面连permute都删了……我不知道具体原因。

找个我是在外面进行了permute,维度顺序是一致的,不然也没法计算。不过我想和你确认的是,你是基于resnet50 backbone的预训练权重,然后fine-tune就可以在VOC上达到77的MAP吗?那此时的val loss是多少呢?我也是采用resnet的backbone预训练权重,也没法达到这个77,而且val loss达到2.5的时候,就会反向上升(虽然我看了下原作者的repo说hm loss是正常的)。模型确实是学到东西了,直接测训练集Map是89,但验证集只有40多。很难受。。。

当然,上传前我已经测试过了,100epoch大概到76.多,之前是77多,因为之前学习率较大,现在增大epoch后也可以77。

你是我提供的数据集么, 我是freeze batch为32,unfreeze batch16

我是用voc2012的,训练集15000多张,验证集1700多张。我用同样的数据集,训练你最新的repo,上周五下载的。map只有28。。。

下次问问题说清楚情况。 VOC2012的数据集你用labelimg打开就知道,里面有些标注是不完全的,因为有一些不是拿来目标检测的。

可以,那我试试VOC2007

是07+12,我都提供了为啥不用呢

单07训练集就5000张,效果又不一样

是07+12,我都提供了为啥不用呢

你这个是自己改过标注的吗?还是整理过官方的呢

https://www.bilibili.com/read/cv10239076?spm_id_from=333.999.0.0

谢谢耐心解答,麻烦了。

你好,您的邮件我已收到。我将在近期查看,尽快给你回复。