ZTurboX

ZTurboX

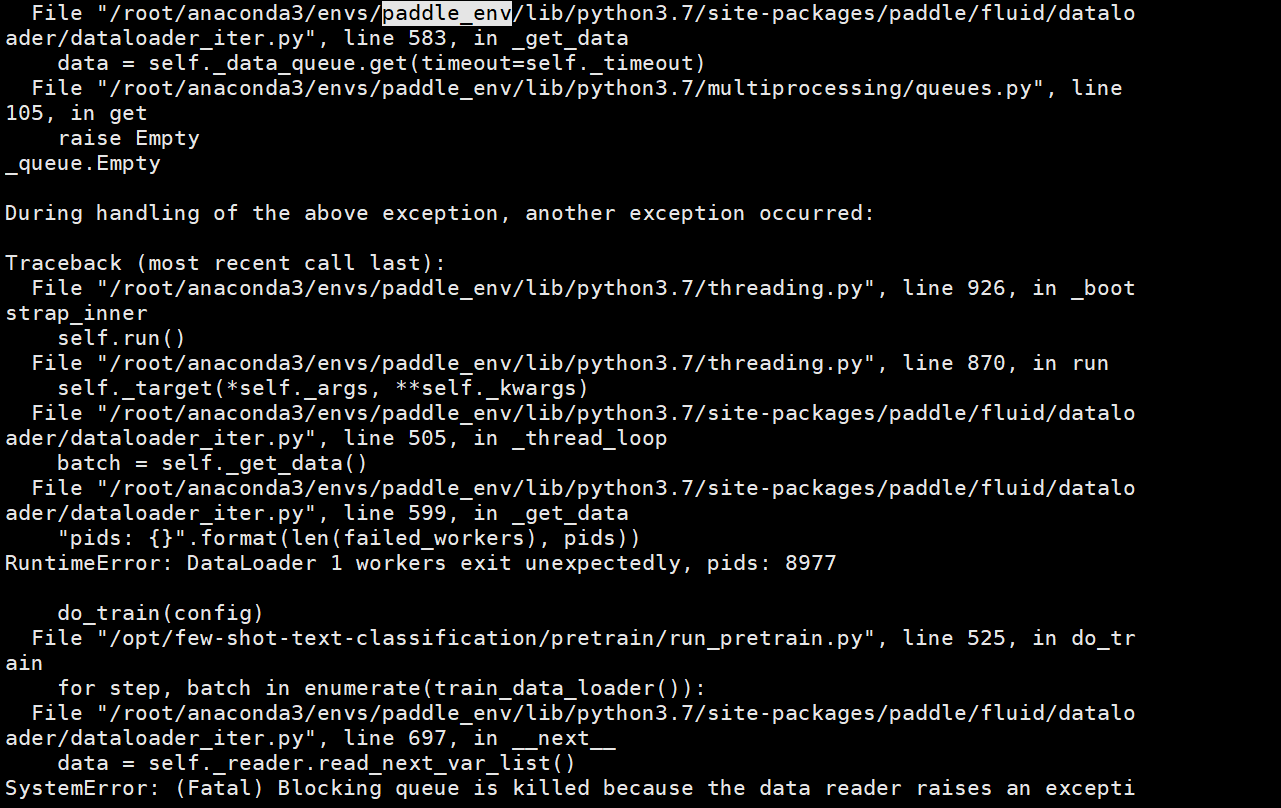

> 比较大的话,可以传云盘, 比如 https://drive.google.com/ 。比较小的话,也可以直接加用户群,发给我们。 最新的报错,是不是因为多进程分布式的原因,我只有一张卡训练

> pip install faster_tokenizer Looking in indexes: https://mirror.baidu.com/pypi/simple ERROR: Could not find a version that satisfies the requirement faster_tokenizer (from versions: none) ERROR: No matching distribution found for faster_tokenizer

> 你的系统是不是windows系统?windows的faster_tokenizer会在版本发布 是win系统。“windows的faster_tokenizer会在版本发布“这个什么意思

> 抱歉,是在后续的版本发布 好的

> 本周我们会开源一个加速版本,例如多核预测,INT8量化,速度会有提升 好的。如果自己微调后,做加速,是参考ernie3.0中的方法吗?

> 本周我们会开源一个加速版本,例如多核预测,INT8量化,速度会有提升 uie更新了在gpu下的加速方案,有么有在cpu加速方案呢

> 您好,2.4.1版本是直接转成静态图导出的 报错信息: ```shell The behavior of expression A + B has been unified with elementwise_add(X, Y, axis=-1) from Paddle 2.0. If your code works well in the older versions...

> 您好,怎么使用的代码,是不是在pipeline框架中import paddle了? 会用到paddlenlp来处理数据

> 预测结束后,内存占用很大,有么有哪里可以配置内存的优化

> 有厂内同学使用pipeline serving部署过TTS(Text to Speech)。大致的思路如下:有2个模块构成TTS服务:前端模块 + pipeline serving。前端模型将段落划分为多个句子,多线程请求Serving服务,Serving使用多进程并发处理,将全部推理结果返回后,由前端模块生成语音效果。 > > 由于模型要保密,并没有开源,可参考思路 感谢